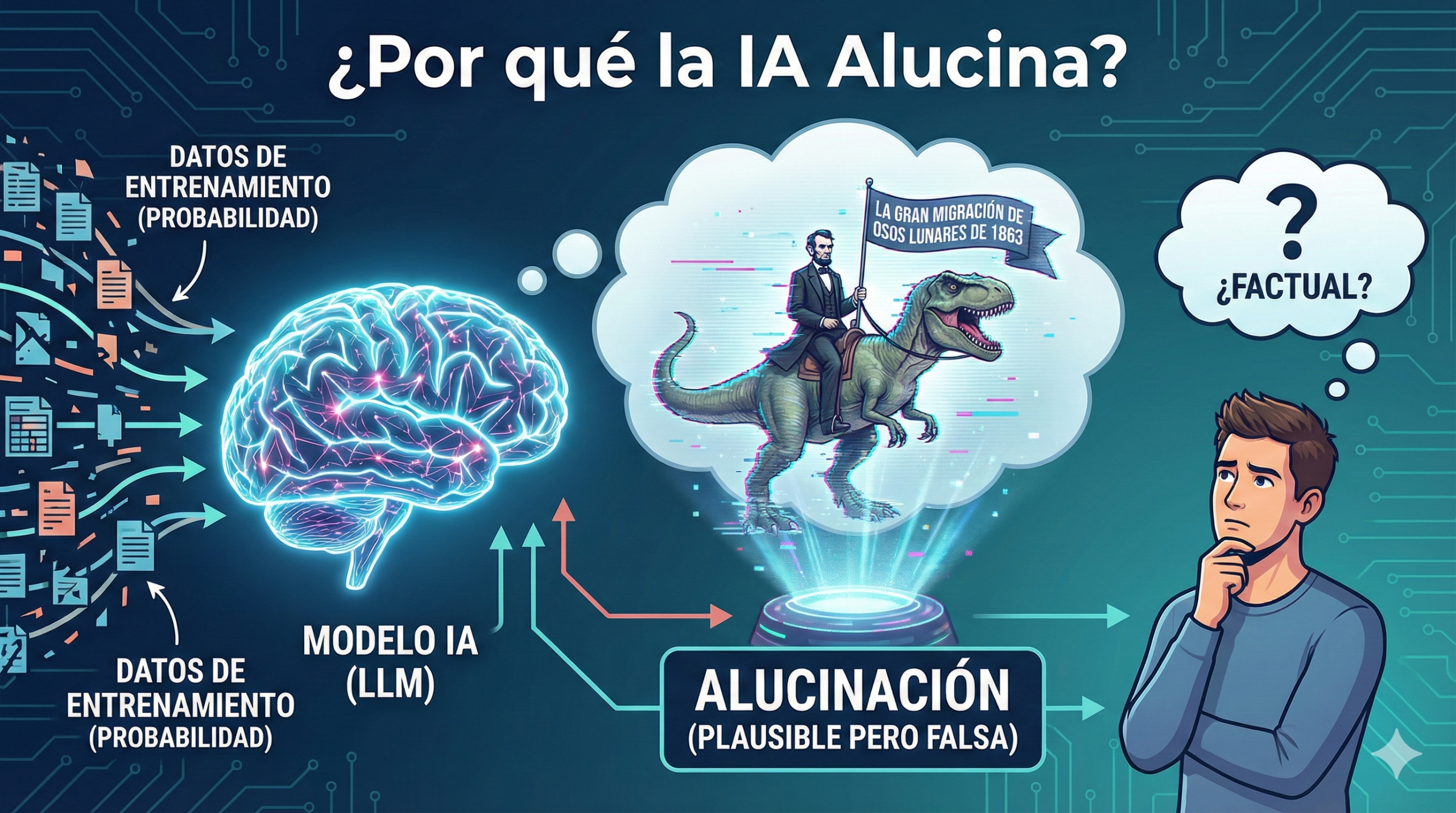

¿Por qué la IA alucina? Explicación

"Le pedí un dato a ChatGPT y se lo inventó con total seguridad". A esto lo llamamos alucinación. Para dejar de frustrarte y empezar a usar la IA con seguridad, necesitas entender un secreto fundamental: la IA no sabe lo que es la verdad, solo sabe lo que es probable. Te explicamos cómo funciona su "mente" sin una sola línea de código.

El Mecanismo: La IA no "sabe", solo "predice"

Para entender por qué ocurre, debes romper un mito fundamental: Una IA tipo LLM no es una base de datos.

Cuando buscas algo en Google, el sistema va a una "estantería" digital, busca el dato exacto y te lo trae. Si no está, te dice "no encontrado".

Una IA no tiene estanterías. No "recuerda" la Revolución Francesa como tú recuerdas tu primer beso. Lo que tiene son billones de conexiones matemáticas sobre la probabilidad de que ciertas palabras aparezcan juntas.

El mecanismo central es la predicción de la siguiente palabra (Next Token Prediction).

Analogía Humana: El "Cuñado" muy leído

Imagina que estás hablando con esa persona que ha leído muchísimo sobre todos los temas, pero que no tiene acceso a internet en ese momento. Es elocuente, seguro de sí mismo y tiene una memoria asociativa increíble.

Si le preguntas: "¿Cuál es la capital de Francia?", su cerebro asocia rápidamente y dice "París". La probabilidad es altísima.

Pero si le preguntas por algo muy específico y poco común, por ejemplo: "¿Quién ganó la tercera división de la liga de bádminton de 1992?", su cerebro no encuentra una asociación fuerte.

Aquí está la clave: Un humano normal diría "No lo sé". Pero el objetivo fundamental de la IA es completar el patrón, no ser veraz. La IA siente la presión matemática de dar una respuesta que suene plausible.

Entonces, con total seguridad, te dirá: "El Club Bádminton Oviedo". ¿Es verdad? Probablemente no. ¿Suena como una respuesta válida? Sí. Eso es una alucinación.

Ejemplo Visual: El Autocompletar con esteroides

Piensa en el teclado predictivo de tu móvil. Si escribes "Buenos", te sugiere "días" o "aires". No porque *sepa* qué hora es o dónde estás, sino porque estadísticamente esas palabras suelen ir juntas.

Un LLM como los de OpenAI o Google es eso mismo, pero en lugar de mirar solo la palabra anterior, mira las últimas 100.000 palabras de la conversación (la ventana de contexto) y ha sido entrenado con todo internet. Es un "autocompletar" increíblemente sofisticado.

Quiébre del Mito

Mito: "La IA me miente a propósito."

Realidad: La IA no tiene concepto de "verdad" o "mentira". Solo tiene concepto de "alta probabilidad" o "baja probabilidad" de que una secuencia de palabras sea coherente.

Aplicación Práctica y Limitaciones

Entender este mecanismo cambia cómo usas la IA:

- Nunca uses un LLM estándar como fuente única de verdad para datos factuales (fechas, leyes, citas médicas) a menos que esté conectado a internet (como Perplexity) y te dé fuentes.

- Siempre verifica los datos críticos.

- Usa la IA para lo que es buena: Razonar sobre información que tú le das, reescribir, hacer brainstorm, estructurar ideas o programar (donde el código funciona o no funciona, y es fácil de verificar).

Las alucinaciones se están reduciendo con mejores técnicas, pero mientras el mecanismo central sea la predicción probabilística, el riesgo de que la IA "rellene los huecos" siempre estará ahí.