Mejor IA Offline para Abogados en 2026

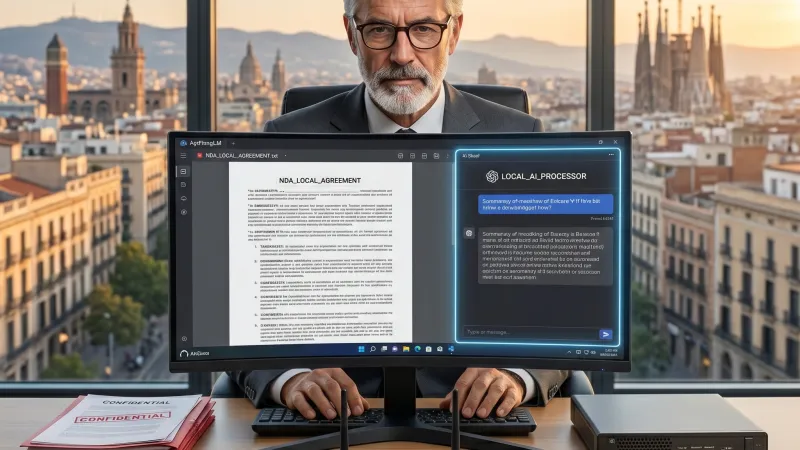

IA Local para Privacidad: Cómo analizar documentos confidenciales sin internet

En IAFlow.es hemos detectado una de las búsquedas más recurrentes (y peor respondidas) en el sector legal, médico y financiero de este 2026: "¿Cómo usar IA para resumir PDFs sin subir los datos a internet?"

Subir un contrato de confidencialidad (NDA), un historial médico o los datos fiscales de un cliente a ChatGPT o Claude es, en la mayoría de jurisdicciones europeas, una infracción grave del RGPD. La solución no es renunciar a la IA, sino llevársela a casa. Hoy analizamos el stack definitivo para este problema: Ollama + AnythingLLM.

¿Qué es y para qué sirve realmente este ecosistema local?

A diferencia de las herramientas SaaS (Software as a Service) por las que pagas una suscripción mensual, estamos hablando de descargar el "cerebro" de la inteligencia artificial directamente a tu ordenador.

- Ollama: Es el motor. Una aplicación gratuita que te permite ejecutar Modelos de Lenguaje Grandes (LLMs) de código abierto (como Llama 3.5 de Meta o Mistral) en tu propia máquina.

- AnythingLLM: Es la interfaz. Un programa que se conecta a Ollama y te permite subir tus propios PDFs, Word o Excel para "chatear" con ellos de forma 100% privada y offline.

"Si desconectas el cable del router, este sistema sigue funcionando. Es el equivalente digital a encerrar a un analista superdotado en una caja fuerte sin ventanas." - Equipo de Privacidad de IAFlow.es

Sirve para que un abogado pueda volcar 500 folios de sumarios judiciales y pedirle a la IA: "Extrae todas las menciones a la empresa X y dímelo en orden cronológico", con la garantía técnica y legal de que esos datos nunca han salido de su disco duro.

Análisis Crítico: La Curva de Aprendizaje y el Cuello de Botella Físico

El marketing de las herramientas Open Source suele pintar todo demasiado fácil. La realidad es que instalar este ecosistema en 2026 ha mejorado enormemente respecto a los dolorosos scripts de 2024, pero sigue teniendo fricciones.

El verdadero coste: El Hardware

Aunque el software es gratuito, la IA local devora recursos de hardware. Ya no pagas suscripciones, pero pagas en silicio. Afortunadamente, ampliar el almacenamiento hoy en día es casi trivial; los precios han bajado al punto de que puedes conseguir un SSD muy capaz por unos 50€ en plataformas como Amazon, lo cual es vital porque cada modelo de lenguaje que descargues pesará entre 5 y 15 Gigabytes. Sin embargo, el verdadero muro es la Memoria RAM y la Tarjeta Gráfica (GPU).

| Componente | Requisito Mínimo (Lento) | Requisito Recomendado (Fluido) | Ecosistema Mac (Apple Silicon) |

|---|---|---|---|

| Memoria RAM | 16 GB (Solo para modelos de 8B parámetros) | 32 GB o 64 GB (Para modelos avanzados) | Memoria Unificada (M2/M3/M4) rinde excelentemente. |

| GPU (Gráfica) | Nvidia RTX 3060 (8GB VRAM) | Nvidia RTX 4070 o superior (12GB+ VRAM) | No requiere GPU dedicada extra. |

| Almacenamiento | SSD Básico | SSD NVMe de alta velocidad | Almacenamiento interno de fábrica. |

Limitaciones Cognitivas

Hay que ser realistas: un modelo local de 8.000 millones de parámetros (que cabe en un portátil normal) no es tan inteligente ni escribe tan bien como GPT-4o o Claude 3.5 Sonnet. Es excelente para extracción de datos, resúmenes y búsqueda de información en tus PDFs, pero sufrirá si le pides razonamientos lógicos muy complejos o redacción creativa de alto nivel.

Caso de Uso Ideal: ¿Quién debería usar esto?

Ideal para: Despachos de abogados, gestorías fiscales, clínicas privadas, departamentos de Recursos Humanos y peritos judiciales. Cualquier profesional que maneje datos protegidos (Nivel Alto) donde una filtración suponga una multa millonaria o la pérdida de la licencia profesional.

¿Quién NO debería usar esto?

Si eres un copywriter, un creador de contenido o una agencia de marketing publicitario, huir de la nube no tiene sentido. Tus datos no son sensibles y perderás mucho tiempo configurando hardware para obtener un modelo que redacta peor que las versiones de pago en la nube.

Veredicto IA Flow: Opinión final sincera. ¿Vale la pena el esfuerzo?

Como analistas del mercado de 2026, nuestro veredicto es rotundamente SÍ para el sector corporativo que maneja datos sensibles.

La combinación de Ollama y AnythingLLM ha democratizado la privacidad. Hace solo dos años, tener una IA privada corporativa costaba decenas de miles de euros en servidores dedicados. Hoy, una pequeña asesoría puede comprar un Mac Studio o un PC de gama media-alta por 2.000€, instalar este stack en una tarde, y tener un asistente infatigable revisando contratos sin pagar un solo euro de licencia mensual y cumpliendo al 100% con la ley de protección de datos.

No es la IA más lista del mundo, pero es la única en la que realmente puedes confiar los secretos de tus clientes. Y en ciertos negocios, la confianza vale mucho más que la elocuencia.